No sé muy bien qué es la Inteligencia Artificial, más que por desconocimiento (que también) por la velocidad a la que avanza el término y lo que engloba.

De todas formas, creo que nos hacemos una idea de que la llamada IA está en todos los aspectos de nuestras vidas por lo que sería lógico pensar en que es una herramienta y que tenemos que aprender a usarla, cómo tuvimos que hacer cuando empezamos a afilar piedras y a mirar con ojos golosos las posesiones de nuestros no-tan-amigos.

Por lo poco que veo, creo que aún no se han superado las Tres Leyes de la Robótica de Isaac Asimov de 1942. Son sencillas y seguramente insuficientes (como bien pone de ejemplo Caliban o incluso la adaptación de Yo, Robot).

Primera Ley: Un robot no hará daño a un ser humano ni, por inacción, permitirá que un ser humano sufra daño.

Segunda Ley: Un robot debe cumplir las órdenes dadas por los seres humanos, a excepción de aquellas que entren en conflicto con la primera ley.

Tercera Ley: Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la primera o con la segunda ley

Isaac Asimov

Leyendo en Microsiervos: Naciones Unidas anuncia un acuerdo de 193 países acerca de la «Ética de la Inteligencia Artificial»

Los Estados Unidos fueron de los primeros países en publicitar sus Principles of Artificial Intelligence ethics for the Intelligence Community

El Gobierno de España tiene un microsite donde han colgado un par de PDFs con los principios y la estrategia sobre Inteligencia artifical

Pero volviendo al principio…

¿Es un simple algoritmo automatizado una Inteligencia Artificial? ¿No deberíamos aplicar una «deontología» del uso del dato en todo lo que hacemos? Por ejemplo, sería bueno saber cómo enfrentarnos a situaciones como la que puedes leer en el artículo El algoritmo escolar que destrozó a toda una generación de estudiantes.

La decisión de Reino Unido de utilizar un algoritmo para fijar las notas de acceso a la universidad ha terminado en desastre. El sistema perjudicó de manera desproporcionada a los alumnos de clase trabajadora y a las comunidades desfavorecidas e infló las notas de los de escuelas privadas

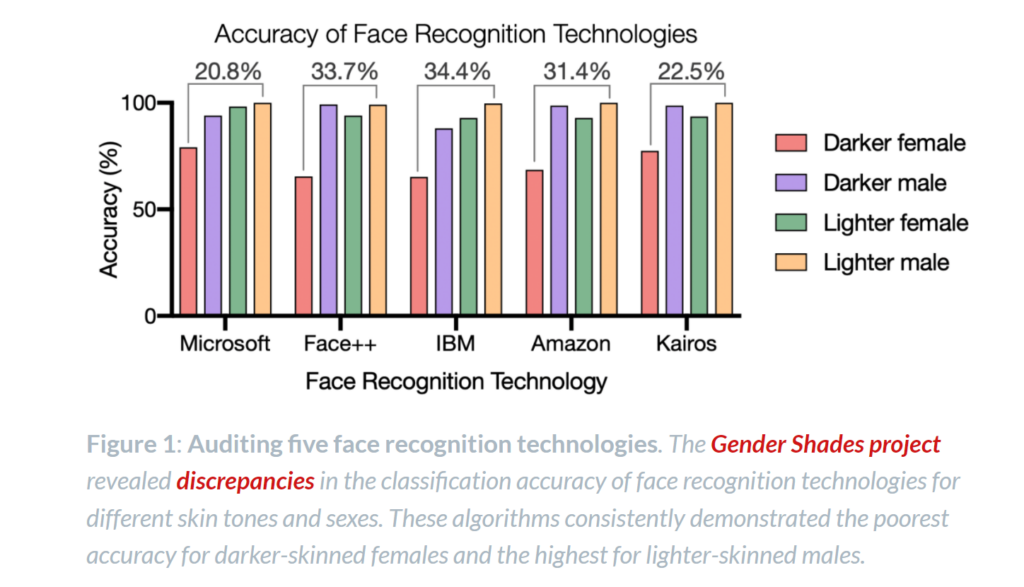

También hay ejemplos muy míticos de racismo en los algoritmos de reconocimiento facial: Racial Discrimination in Face Recognition Technology (Harvard University)

Incluso en la UX. Aquí recomiendo seguir a Daniela Peñaranda aka @ahappydesigner que tiene conversaciones muy interesantes sobre el impacto de la ética en el diseño de productos y servicios y lo recuerdo que «Facebook chooses maximum engagement over user safety» mientras leo en el Washington Post A whistleblower’s power: Key takeaways from the Facebook Papers.

Ya sin meternos a los sistemas más complejos como los armamentísticos y censura (como estamos sufriendo en España con la Ley Iceta), los «scoring» de riesgos a la hora de conceder un préstamo, el llamado Scoring Social Chino, etc.

Así que…

Hoy he aprendido que Naciones Unidas ha anunciado un acuerdo de 193 países acerca de la Ética de la Inteligencia Artificial… pero no parece suficiente